Báo cáo do nhóm Nghiên cứu và Phân tích toàn cầu của Kaspersky công bố cho thấy, các dịch vụ video và âm thanh giả mạo (deepfake) theo thời gian thực được rao bán với khởi điểm 30 USD (800.000 đồng) cho tin nhắn thoại giả, 50 USD (1.300.000 đồng) cho video giả. Giá tiền có thể thay đổi tùy theo độ phức tạp và thời lượng nội dung.

Trong khi đó, các báo cáo trước đây ghi nhận các dịch vụ tạo deepfake dao động từ 300 đến 20.000 USD/phút, tức hiện đã rẻ hơn hàng chục lần.

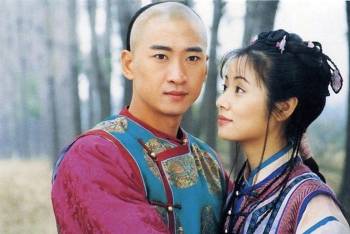

Thử nghiệm dùng mặt giả để kiểm tra khả năng xác thực khuôn mặt trên một ứng dụng điện thoại. Ảnh: Lưu Quý

Theo chuyên gia, các gói deepfake này còn cho phép kẻ xấu nhanh chóng tạo âm thanh, video giả mạo theo thời gian thực. Một số quảng cáo dịch vụ còn hứa hẹn nhiều tùy chọn tính năng, bao gồm đổi gương mặt (face swapping) thời gian thực trong cuộc gọi video trên nền tảng hội nghị trực tuyến, "thay" mặt để xác thực, cũng như giả mạo nguồn phát camera trên thiết bị, công cụ giả giọng nói (voice cloning), cho phép bắt chước giọng nói và điều chỉnh cao độ, âm sắc để thể hiện cảm xúc khác nhau.

Tại hội nghị về an toàn thông tin CIO CSO 2025 đầu tháng 10, chuyên gia từ công ty An ninh mạng Viettel cũng cảnh báo về sự phát triển của deepfake hỗ trợ các hoạt động lừa đảo qua giọng nói (vishing) và video. Ví dụ, một công ty tư vấn tại Hong Kong (Trung Quốc) từng bị kẻ lừa đảo giả mạo giám đốc tài chính, thực hiện cuộc gọi video và ra lệnh chuyển tiền, khiến công ty thiệt hại 25 triệu USD.

"AI đã hạ thấp rào cản kỹ thuật của kẻ tấn công xuống rất nhiều. Những người không có nhiều kiến thức về kỹ thuật cũng có thể tham gia tấn công", chuyên gia này đánh giá.

Theo ông Dmitry Galov, Trưởng nhóm Nghiên cứu và Phân tích toàn cầu của Kaspersky, thị trường chợ đen không chỉ bùng nổ các quảng cáo dịch vụ deepfake, mà nhu cầu sử dụng thực tế công cụ này cũng ngày càng gia tăng.

Các chuyên gia cũng phát hiện kẻ gian đang tích cực ứng dụng AI, trong đó nhiều nền tảng phát triển những mô hình ngôn ngữ lớn (LLM) độc hại được xây dựng hoàn toàn từ đầu, tách biệt với mô hình LLM công khai và có thể chạy trực tiếp trên thiết bị của tội phạm.

"Dù công nghệ này chưa tạo ra mối đe dọa mạng hoàn toàn mới, chúng khiến kẻ tấn công trở nên nguy hiểm hơn đáng kể", ông Galov đánh giá.

Trong bối cảnh đó, giới bảo mật khuyến nghị một trong những hướng đi triển vọng là tận dụng chính AI để vừa tăng năng suất của các chuyên gia bảo mật, vừa nâng cao hiệu quả phòng vệ.

Ngoài việc trang bị công cụ bảo vệ, chuyên gia Kaspersky cũng cho rằng các tổ chức, doanh nghiệp cần đảm bảo nhân viên hiểu về deepfake và mức độ nguy hiểm của công nghệ, đồng thời thường xuyên tổ chức khóa đào tạo để giúp nhân viên biết cách nhận diện. Một số dấu hiệu đặc trưng của deepfake có thể dùng để nhận biết như chuyển động bị giật, không mượt, ánh sáng không đồng nhất giữa các khung hình, tông màu da thiếu tự nhiên, chớp mắt bất thường hoặc ít chớp mắt, hình ảnh bị méo, biến dạng, video cố tình quay ở chất lượng thấp hoặc ánh sáng kém.

Lưu Quý